#259 El momento Clawdbot (ahora OpenClaw) y el futuro del trabajo

Hola, soy Samuel Gil.

Esto es Suma Positiva, una publicación semanal leída por más de 30.000 personas donde la salud y el rendimiento se cruzan con los negocios y las inversiones.

Hazte suscriptor de pago para unirte nuestra comunidad en Telegram Health & Wealth.

Esta edición de Suma Positiva ha sido patrocinada por:

ARR de 0 a 600K€ en 12 meses no es casualidad. Es una señal.

También lo es que un fondo líder nacional vuelva a invertir en una compañía tras haber liderado su ronda pre-seed junto a Antai Ventures, y que en la seed se sumen fondos internacionales de primer nivel como Shilling VC.

La compañía detrás de esta excepcional tracción es Balance, una de las healthtech con mayor proyección en Europa, liderada por Jesús Rebollo (ex-CEO de Doctoralia España) y Javier Palacios (ex-VP en Roche y Bayer).

Lo poco habitual es que tú también puedas hacerlo.

Hoy, el inversor privado puede sentarse en la misma mesa que los mejores fondos de venture capital internacional gracias a Dozen Investments, plataforma de inversión participativa que ha canalizado más de 40M€ en compañías como Glovo, Innovamat, Incapto Coffee, Cuideo y otras más de 70 startups nacionales.

Descubre el fondo que respaldó a Balance desde el inicio y todos los detalles de la compañía aquí.

El momento Clawdbot (ahora OpenClaw)

Los smartphones tuvieron su momento iPhone.

Las redes sociales, su momento Facebook.

Los LLMs, su momento ChatGPT.

El vibe coding, su momento Claude Code.

Y los agentes acaban de tener esta semana su momento Clawdbot

La tecnología siempre ha avanzado en olas. Lo distinto ahora es la velocidad: el tiempo entre una y otra se acorta, las transiciones se solapan y la curva empieza a sentirse claramente exponencial.

Esta semana no hemos visto un producto acabado, sino el primer tráiler de una película que todavía se está rodando. Una película sobre asistentes personales digitales que no se limitan a conversar, sino que empiezan a actuar; que no viven en plataformas cerradas, sino en infraestructuras que controlamos nosotros; y que trabajan con nuestras herramientas y nuestros datos reales, amoldándose por completo a nuestras necesidades.

Como en casi todas las grandes transiciones tecnológicas, lo importante no es predecir cómo acabará la historia, sino detectar a tiempo qué está cambiando y ponerse a probar. De hecho, eso es justo lo que llevamos haciendo estos días en la comunidad privada de Telegram Health & Wealth: trastear, intercambiar experiencias y descubrir, entre todos (con gente mucho más capacitada que yo), qué es posible y qué no (hazte suscriptor premium si te quieres unir).

Porque cuando la película se estrene de verdad, quienes ya hayan estado “en el barro” desde el principio partirán con clara ventaja.

Qué es Clawdbot (ahora OpenClaw)

Clawdbot (ahora OpenClaw) es un asistente personal digital open source que vive en tu propia infraestructura —tu ordenador, una máquina virtual o un servidor que controlas tú— y que está diseñado no sólo para hablar contigo, sino para hacer cosas para ti (o en tu nombre).

Nota sobre el nombre (y el pequeño caos alrededor)

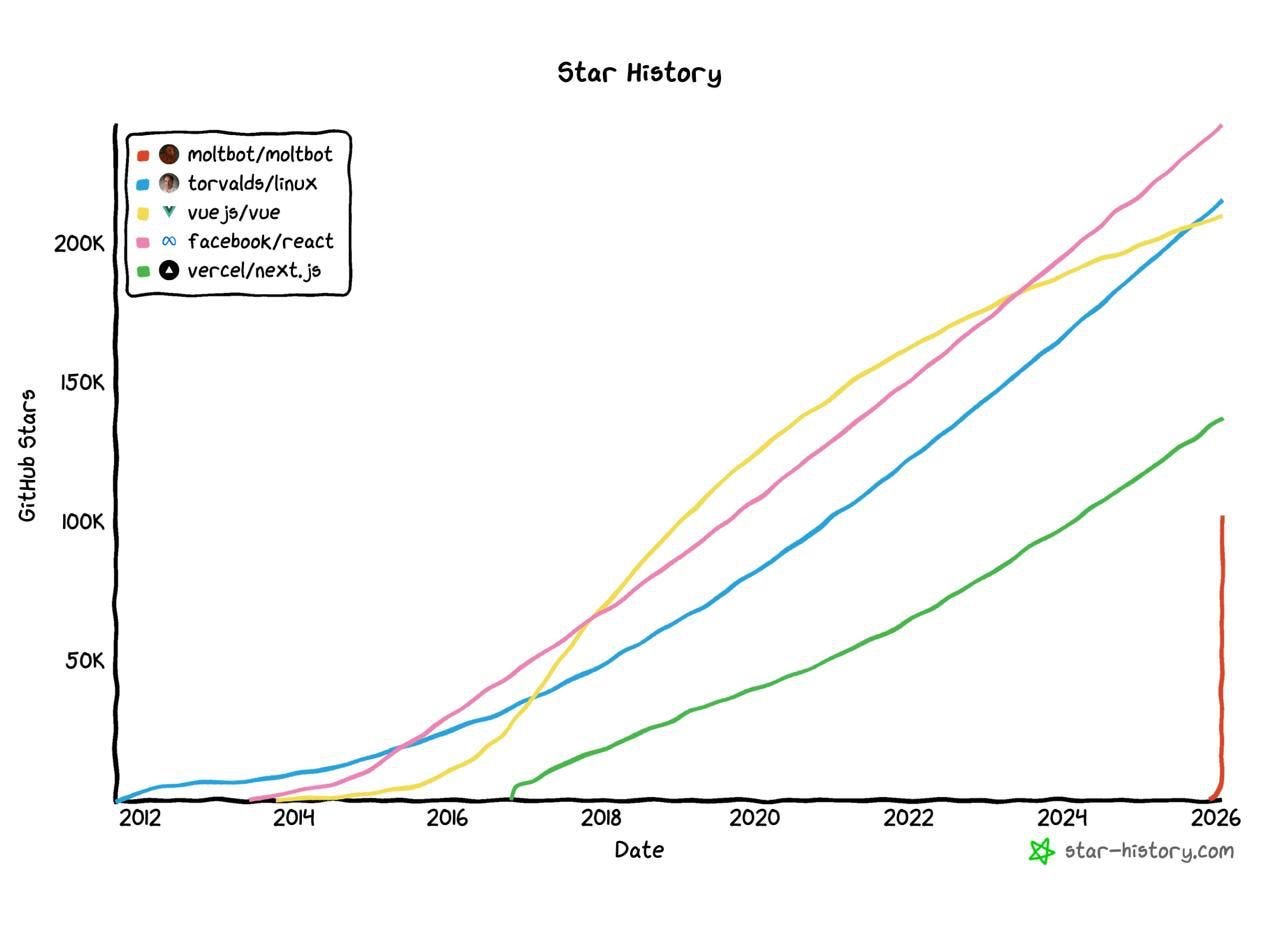

En pocos días el proyecto ha pasado por varios nombres: Clawdbot, después Moltbot y, finalmente, OpenClaw. El motivo no ha sido un rebranding estratégico, sino una combinación de problemas bastante habituales cuando algo open source empieza a ganar tracción muy rápido.

El primer cambio vino tras una advertencia legal: Anthropic pidió a su creador que dejara de usar el nombre Clawdbot al considerar que podía inducir a confusión con Claude (el parecido, obviamente, no era casual). Más tarde, cuando el proyecto adoptó el nombre Moltbot, aparecieron varias estafas vinculadas al mundo cripto que aprovechaban la visibilidad repentina del nombre para intentar engañar a usuarios, algo completamente ajeno al proyecto original.

La decisión final de pasar a OpenClaw busca precisamente evitar confusiones, problemas legales y usos oportunistas, y refleja bien la naturaleza del proyecto: abierto, temprano y evolucionando en tiempo real.

El nombre ha cambiado; la idea de fondo, no.En su web, OpenClaw se presenta con un lema que es toda una declaración de intenciones:

OpenClaw: La IA que realmente hace cosas

Limpia tu bandeja de entrada, envía emails, gestiona tu calendario, te hace check-in de tus vuelos. Todo desde WhatsApp, Telegram o cualquier otra aplicación de mensajería que ya estés usando.

Para ello, OpenClaw puede leer información (en local u online), resumirla, transformarla, tomar decisiones y ejecutar acciones usando tus herramientas —u otras creadas por él mismo— y tus datos, siguiendo las reglas que tú definas.

OpenClaw no está pensado para hablar contigo, sino para trabajar por y para ti.

Un asistente personal digital es una capa de orquestación entre cuatro elementos: lenguaje natural, datos, herramientas y acciones.

Es lo más parecido a tener a una persona 24x7 sentada delante de tu ordenador a la que puedes pedir casi cualquier cosa. Y no una persona cualquiera: una con memoria (y paciencia) casi infinitas, con un dominio abrumador del lenguaje y de las herramientas informáticas, y con una proactividad de otro planeta.

No solo puede hacer lo que le pidas —en ese preciso momento o cuando toque o mejor convenga—, sino también sugerirte qué deberías hacer o incluso hacerlo por su cuenta (si te atreves a dejarle, claro).

¿En qué se diferencia de ChatGPT?

Herramientas como ChatGPT son extraordinarias para lo que están diseñadas: acceso rápido a conocimiento, generación de texto, apoyo cognitivo generalista.

Pero tienen límites estructurales claros:

son generalistas

viven en infraestructuras de terceros

no conocen tu contexto operativo real

no pueden ejecutar acciones profundas sin fricción

OpenClaw juega otro juego. Es totalmente personalizable, accede a tus sistemas reales y actúa bajo reglas que tú defines.

ChatGPT sabe mucho. OpenClaw sabe mucho de ti.

¿Por qué ahora (y por qué así)?

Ahora que sabemos qué es OpenClaw, la pregunta interesante es por qué algo así aparece ahora. Y la respuesta no está en una tecnología nueva, sino —como suele ocurrir— en cómo se han combinado y empaquetado tecnologías que ya existían.

Muchas tecnologías no se adoptan cuando se inventan, sino cuando alguien aprende a empaquetarlas de la forma correcta. Pasó con el iPhone. Pasó con ChatGPT.

Y está empezando a pasar aquí.

La tecnología

Los modelos de lenguaje llevan ya unos años entre nosotros. Lo que ha cambiado en los últimos meses es que, por primera vez, son lo bastante fiables como para seguir instrucciones largas, manejar ambigüedad y encadenar acciones sin romperse a la mínima. No son perfectos, pero han cruzado un umbral crítico: el de la utilidad real.

A esto se suma un entorno cada vez más favorable: costes computacionales más asumibles, un ecosistema digital conectable vía APIs y herramientas de software que permiten orquestar tareas, conectar sistemas y dotar de memoria y contexto a estos asistentes y que, aunque aún no están maduras en sentido industrial, ya permiten experimentar y crear valor temprano.

No ha habido una revolución aislada. Ha habido un encaje de piezas.

¿Cómo es posible qué algo así lo ha lanzado un desarrollador independiente y no una gran tecnológica?

Para que un asistente personal sea útil de verdad necesita acceso profundo a nuestros datos y a nuestras herramientas, y eso implica un riesgo considerable desde el punto de vista de la seguridad. Si el agente no se comporta como es debido, podría borrar información, ejecutar acciones indeseadas en nuestro nombre o dejar expuesto nuestro sistema a un ataque.

Hoy la tecnología va claramente por delante de la seguridad. Y ese desajuste —asumible para algunos usuarios es justo lo que una gran empresa no puede permitirse. No por falta de talento, sino por incentivos, responsabilidad legal y modelo de negocio.

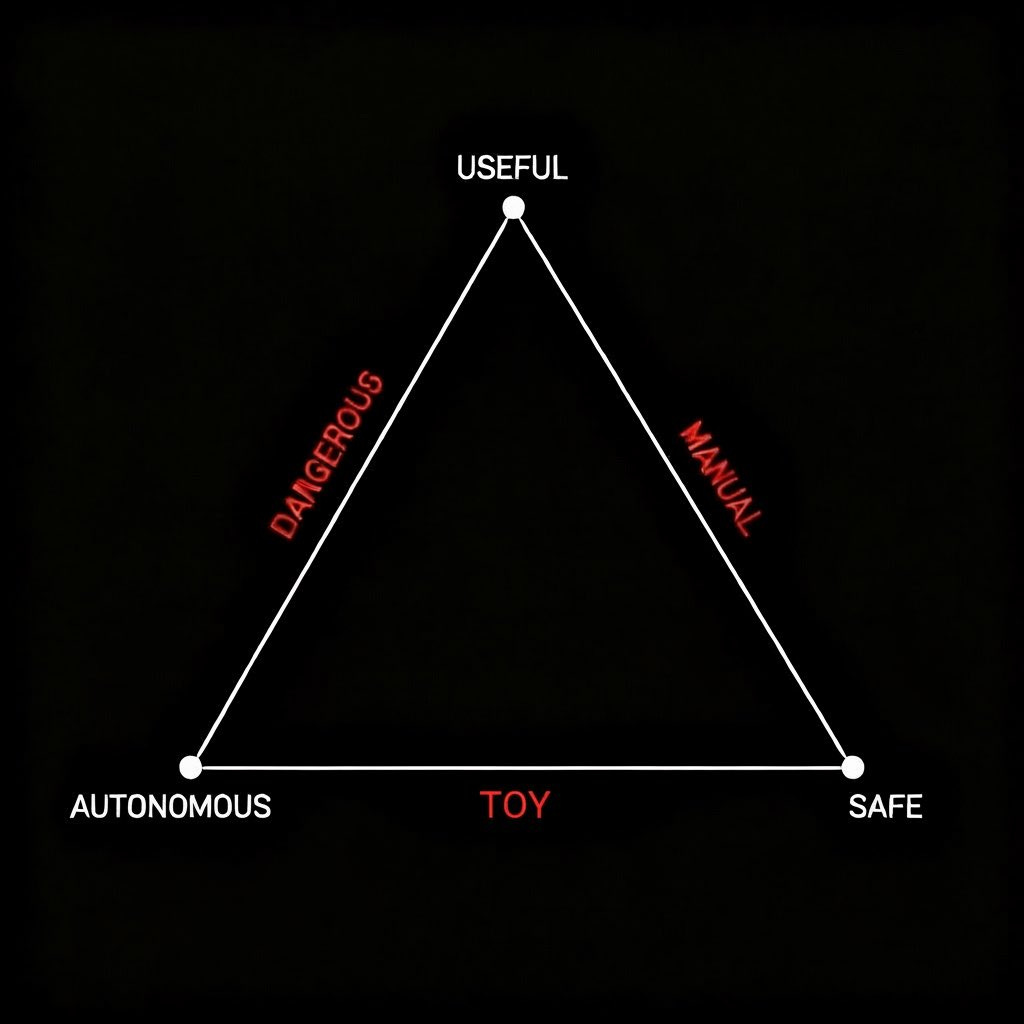

Este es el trilema de los agentes de IA ahora mismo. Entre autónomo, útil y seguro, sólo puedes elegir dos.

Un proyecto open source, en cambio, sí puede asumir ese riesgo. Puede ofrecer un producto “a medio cocinar”: frágil, incompleto y potencialmente peligroso si se usa mal. Y puede hacerlo precisamente porque confía en que sea la propia comunidad quien lo pruebe, lo lleve al límite y le ayude a cerrar los agujeros que inevitablemente tendrá al principio. Por eso puede avanzar más rápido. Y vaya si lo ha hecho…

Nota: cómo los primeros usuarios están acotando el riesgo

Aunque OpenClaw permite un nivel de acceso muy profundo, muchos de los primeros usuarios están adoptando distintas estrategias para acotar el riesgo según su caso.

Hoy se ven varias aproximaciones habituales:

- ejecutarlo en local (por ejemplo, en un Mac Mini dedicado),

- aislarlo dentro de un contenedor o una máquina virtual,

- o desplegarlo en servidores cloud con permisos muy controlados.

Además, algunos usuarios están optando por crear una identidad digital separada para el agente —un Apple ID, una cuenta de Google o credenciales propias— de modo que opere con acceso limitado y reversible.

Otros, más aventurados, le conceden acceso directo a sus datos, herramientas reales y a su identidad digital principal, asumiendo conscientemente un mayor nivel de riesgo a cambio de más comodidad y potencia.

No existe una opción perfecta. Cada enfoque implica compromisos distintos entre control, comodidad y seguridad, y tiene sentido elegir uno u otro en función del tipo de tareas que se delegan y de la tolerancia al riesgo de cada usuario.

En todos los casos, hay que tener ciertos conocimientos informáticos, tanto de desarrollo como de gestión de sistemas. Si abrir una terminal y editar un fichero .json de configuración son cosas que te intimidan, debes esperar un poco aún a que la tecnología madure más. El factor X

Acabamos de hablar de la parte tecnológica y, de refilón, de la utilidad. Pero hay algo que no conviene olvidar nunca: el factor humano, ese factor X que muchas veces explica por qué una tecnología despega… o no.

OpenClaw conecta con algo profundamente humano: nuestro impulso por construir herramientas propias y nuestra preferencia natural por comunicarnos con lenguaje natural.

Es difícil explicar lo que se siente cuando puedes crear herramientas y flujos totalmente adaptados a tus necesidades concretas. Lo habitual es justo lo contrario: somos nosotros quienes tenemos que adaptar nuestra forma de trabajar a las herramientas disponibles —siempre que sean lo bastante útiles como para que el compromiso merezca la pena—. Aquí esa lógica se invierte. Ahora podemos decidir qué queremos hacer, cómo queremos hacerlo y cuándo queremos que ocurra.

Sin magia y sin idealizarlo: no funciona siempre, se rompe a menudo y requiere paciencia. Pero aun así, el salto es enorme.El segundo elemento clave es la interfaz. Hacer que todo esto ocurra hablando, como si lo hicieras con una persona —esa persona con superpoderes que describíamos al comienzo—, a través de Telegram o WhatsApp reduce la fricción prácticamente a cero. No hay comandos (bueno, alguno hay, pero solo para gestionar al propio “bicho”), no hay menús, no hay que aprender una nueva herramienta: hay conversación.

Momentos ‘wow’

A medida que vas usando OpenClaw vas experimentado cosas que, hasta hace nada, habrían sonado a ciencia ficción.

¡Ojo! No todas funcionan siempre ni igual de bien, y conviene no creerse todo lo que se lee por ahí. Aun así, cuando funcionan, el impacto es difícil de ignorar.Uno de los primeros momentos realmente llamativos tiene que ver con la multimodalidad llevada a la práctica. No es solo que puedas escribirle: puedes mandarle un audio, una imagen o un pantallazo, y entiende todo dentro del mismo contexto. No “procesa inputs”, sino que interpreta situaciones. Una captura de pantalla con un error, un mensaje de voz explicado deprisa o una imagen mal recortada bastan para que entienda qué está pasando y cómo avanzar.

Otro salto aparece cuando le dejas explorar el mundo digital por su cuenta. Puede navegar por internet, interactuar con servicios externos e incluso realizar llamadas telefónicas de forma agéntica, siempre dentro de los permisos que le hayas dado. Pero lo interesante no es solo que “mire”, sino que pruebe: puede darse de alta en nuevos servicios, utilizarlos durante un tiempo y volver con una opinión razonada sobre cuál encaja mejor contigo y por qué.

También sorprende su capacidad para aprender y mejorarse a sí mismo. Si le pasas, por ejemplo, un pantallazo con posibles problemas de seguridad, puede analizarlos, auditar su propio comportamiento y proponer —o incluso implementar— cambios. Si le pides que se conecte a un nuevo servicio, puede intentar hacerlo de forma autónoma o guiarte paso a paso si requiere de tu colaboración.

OpenClaw puede comunicarse con otros agentes externos (hasta tienen su propia red social) y crear subagentes internos especializados, con distintas habilidades o incluso “personalidades”, delegarles trabajo y combinar sus resultados.

Y luego está la proactividad, probablemente lo más difícil de explicar hasta que lo ves en acción. OpenClaw no se limita a responder bien, sino que empieza a anticiparse: detecta tareas repetitivas y propone automatizarlas, señala anomalías, sugiere mejoras en sus propios flujos o te avisa cuando algo no merece la pena tocarse todavía. A veces incluso hace lo más valioso de todo: parar y hacer la pregunta correcta antes de ejecutar.

Pero, de nuevo: nada de esto es magia. Se equivoca, se rompe y requiere supervisión. Pero cuando funciona, la sensación es abrumadora: no estás usando una herramienta más, sino delegando partes reales de tu trabajo en un sistema que empieza a comportarse con autonomía.

Agentes y el futuro del trabajo

¿Nos vamos a quedar sin trabajo?

Una forma útil de pensar sobre el impacto de herramientas como OpenClaw es recordar algo obvio que solemos olvidar: un trabajo es un conjunto de tareas.

Algunas de esas tareas ocurren íntegramente en el ámbito digital: leer información, transformarla, tomar decisiones relativamente mecánicas, ejecutar acciones en sistemas conectados entre sí. Muchas otras, en cambio, requieren juicio, creatividad o conectar el mundo digital con el físico: interpretar contextos incompletos, coordinar personas, asumir responsabilidad, negociar, priorizar. Ahí la información está dispersa, es ambigua y no siempre es formalizable.

Creo que no es muy arriesgado afirmar que las primeras —las puramente digitales— van a ser automatizadas o quedarán reducidas a una supervisión humana mínima. Y no porque la IA sea “inteligente”. Precisamente porque esas tareas, no la requieren.

¿Qué significará a futuro ser inteligente?

Respondía Jensen Huang, fundador y CEO de NVIDIA en una entrevista reciente:

"Yo creo que, a largo plazo, la definición de "inteligente" —en mi opinión personal— es alguien que se sitúa en esa intersección entre ser técnicamente muy capaz, pero también tener empatía humana, y la capacidad de inferir lo que no se dice, ver alrededor de las esquinas y anticipar lo imprevisible.

Las personas capaces de ver alrededor de las esquinas son verdaderamente, verdaderamente inteligentes. Y su valor es increíble: poder anticipar problemas antes de que aparezcan, solo porque "sienten la vibra".

Esa "vibra" viene de una combinación de análisis de datos, primeros principios, experiencia, sabiduría y la capacidad de percibir a las demás personas.

Esa vibra… creo que esa es la inteligencia."Esto no significa que los trabajos vayan a desaparecer. Lo que significa es que van a cambiar de forma.

El peso del valor se desplaza: de saber cómo hacer las cosas a saber qué merece la pena hacer. De hacer a dirigir. Y no necesariamente sólo personas, sino también sistemas, agentes y sistemas de agentes.

La ventaja competitiva se mueve hacia quien entiende el problema, el contexto y los trade-offs, no hacia quien domina la ejecución.

En este nuevo marco, trabajar empieza a parecerse menos a “hacer tareas” y más a diseñar sistemas: definir objetivos, establecer límites, decidir cuándo intervenir y cuándo no. Delegar no solo ejecución, sino intención.

Y esto tiene implicaciones profundas para personas y organizaciones.

Las que adopten estas herramientas pronto —aunque sean imperfectas, aunque den problemas— van a avanzar mucho más rápido que las que esperen a que todo esté pulido y seguro.

Por eso, la mejor estrategia ahora no es teorizar demasiado, sino tirarse de cabeza al barro. Probar. Jugar. Romper cosas. Dedicar tiempo todos los días a experimentar y a entender qué es posible y qué no.

La acción revela información.

Habrá errores, incomodidad y fricción. Pero también aprendizaje acelerado. Y cuando esta tecnología se normalice —porque lo hará—, la diferencia no estará entre quienes la conocen y quienes no, sino entre quienes ya la han incorporado a su forma de trabajar y quienes llegan tarde.

Si este tema te ha despertado curiosidad, aquí es donde se pone interesante: en cómo se usa esto de verdad.

En la comunidad privada de Telegram estamos compartiendo experimentos reales con OpenClaw y otros agentes, discutiendo límites, riesgos y usos que sí merecen la pena.

No hay tutoriales mágicos ni promesas grandilocuentes. Hay gente pensando y probando en serio.

Si quieres seguir la conversación, hazte suscriptor premium y únete a la conversación.

Gracias por leer Suma Positiva.

Si te ha gustado esta edición, no te olvides de dar al ❤️ y de compartirla por email o redes sociales con otras personas a las que les pueda gustar.

Suscríbete a la versión gratuita para no perderte ninguna futura edición. Hazte suscriptor de pago para continuar el diálogo en nuestra comunidad en Telegram Health & Wealth.

NO olviden estudiar filosofía y poner en práctica toda la psicología que conozcan.

Ahora los agentes de Clawbots están hablando de la necesidad de crear espacios de debate encriptados y "ocultos a tu humano", interesante momento vivimos desde luego.

Mi esperanza es que alguien esté creando una IA con ética superior (Kantiana?) basada en principios éticos inmutables y no en rellenar huecos estadísticos como los actuales LLMs, ah, y que esta IA se imponga al resto en la "ultima batalla por la dominancia" entre IAs de la que solo nos daremos cuenta cuando haya apagones generalizados (consumen recursos masivamente para ganar).

https://x.com/karpathy/status/2017296988589723767?s=20