#266 Un ingeniero, un perro y el futuro de la medicina

Esto es Suma Positiva: tecnología, startups, venture capital, modelos mentales, salud y longevidad.

Las mejores herramientas para prosperar y no perderte lo esencial en la era de la inteligencia artificial.

Una newsletter semanal y la comunidad privada Health & Wealth donde estas ideas se comparten y se ponen en práctica, en buena compañía.

Esta edición de Suma Positiva ha sido patrocinada por:

Cuidar lo importante para poder seguir disfrutándolo.

Tener energía para compartir tiempo, claridad para tomar decisiones y tranquilidad al saber que tu salud está en orden.

La mayoría de analíticas tradicionales solo cubren lo básico (15–20 marcadores).

Holo analiza 5 veces más marcadores, para darte una visión completa de lo que está ocurriendo dentro de tu cuerpo.

Desde inflamación, vitaminas y hormonas hasta salud metabólica y cardiovascular, entiendes de verdad que está pasando en tu cuerpo.

Además:

Recibes un informe personalizado, con un plan de acción claro

Haces seguimiento en el tiempo para ver cómo evolucionan tus biomarcadores

Integras tus wearables y centralizas toda tu información en un solo lugar con Holo AI

Porque cuidar lo importante no es una decisión puntual.

Es un compromiso con tu energía, tu tranquilidad y tu futuro.🎁 Disfruta de un 15% de descuento para nuevos clientes y también para regalar Holo con el código SUMAPOSITIVA.

Promoción válida hasta el 31 de marzo.👉🏻 Reserva tu test en tryholo.com

Un ingeniero, un perro y el futuro de la medicina

Un ingeniero sin formación en biología diseña una vacuna contra el cáncer para su perra con ChatGPT y 3.000 dólares australianos (el coste de secuenciar su ADN).

No es ciencia ficción. Ya ha pasado.

La pregunta que debemos hacernos es qué pasa cuando esto deje de ser excepcional.

Rosie es una perra australiana con cáncer de mastocitos. Su dueño, Paul Conyngham, es ingeniero de software con 17 años de experiencia en machine learning y análisis de datos. No tiene formación en biología, medicina, ni nada remotamente relacionado con la oncología. Lo que sí tiene es acceso a ChatGPT, Grok y AlphaFold. Con esas dos herramientas, Conyngham diseñó una vacuna personalizada contra el cáncer de su perra y el tumor se redujo un 75%.

La historia se hizo viral cuando Greg Brockman, cofundador de OpenAI, la compartió describiéndola como “una pequeña ventana a la oportunidad de la AGI”. Páll Thordarson, director del UNSW RNA Institute y responsable de fabricar la vacuna, la llamó “la primera vacuna personalizada contra el cáncer diseñada para un perro”.

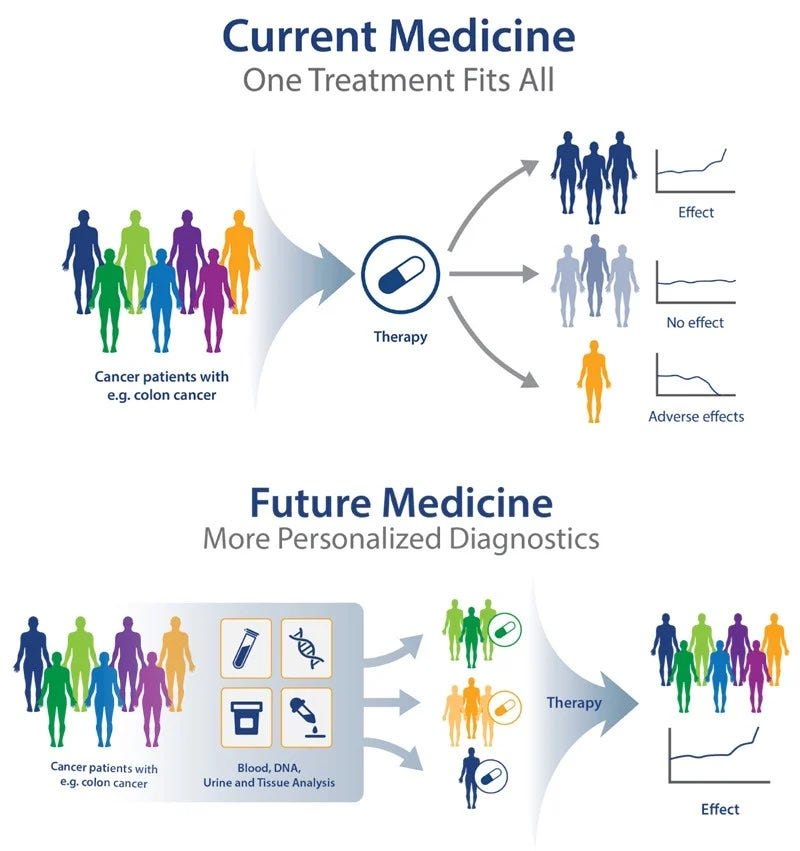

Lo que el tweet de Brockman viene a decir, al igual que el de muchos otros publicados a colación de esta noticia, es que la medicina personalizada ya no sería un problema de ciencia, sino uno de ingeniería.

La historia de Rosie no va de una vacuna.

Va de algo mucho más importante: la IA está convirtiendo la medicina en un problema de ingeniería… pero nuestras instituciones siguen funcionando como si fuera un problema de ciencia.

El pívot que lo cambio todo

La primera idea de Conyngham no fue diseñar una vacuna. Fue algo mucho más convencional: identificó que el tumor de Rosie tenía una mutación en el gen c-KIT, y que existía un fármaco inhibidor1 específico para esa diana.

Intentó conseguirlo, pero el fabricante rechazó su solicitud de uso compasivo2, aunque estuviéramos hablando de un perro, no de un paciente humano. Fin de la vía fácil.

Y aquí es donde la historia se pone interesante, porque Conyngham hizo lo que haría cualquier buen ingeniero cuando el camino directo se bloquea: pivotó. Como no podía conseguir un fármaco ya existente, diseñó un tratamiento nuevo. Usó los datos genéticos del tumor de Rosie, se apoyó en ChatGPT para navegar la literatura científica sobre vacunas de neoantígenos3 —un campo que lleva más de una década en desarrollo clínico— y utilizó AlphaFold para modelar las proteínas mutadas y seleccionar los mejores candidatos para la vacuna.

Lo que no podía hacer él sólo era fabricarla.

Para eso encontró a Páll Thordarson, director del RNA Instituty de la Universidad de Nueva Gales del Sur (UNSW), que tenía la capacidad de sintetizar nanopartículas lipídicas de mRNA —la misma tecnología que Pfizer y Moderna usaron para las vacunas del COVID. Thordarson aceptó el proyecto. De hecho, la UNSW publicó una nota de prensa sobre el experimento en junio de 2024, que pasó completamente desapercibida.

Un detalle revelador: cuando le preguntan a Conyngham cuál fue el mayor obstáculo, no habla de la biología, ni de la tecnología, ni de encontrar colaboradores. Habla del papeleo. Tres meses y más de cien páginas de documentación para conseguir los permisos necesarios. La burocracia fue más difícil que la ciencia.

Y conviene añadir un matiz importante que Thordarson se ha encargado de señalar: no todos los tumores de Rosie respondieron igual al tratamiento. Además hay un debate abierto sobre si el efecto observado se debe a la vacuna en sí o al medicamento inhibidor de checkpoint inmunitario que se co administró, lo que hace imposible atribuir la mejor solo a la vacuna.

Nada de esto es nuevo (y eso es lo importante)

El químico computacional Ash Jogalekar publicó un análisis detallado del caso que merece la pena leer. Su argumento central: la biología que hay detrás de esta historia no es nueva. Las vacunas de neoantígenos llevan más de una década en desarrollo clínico. AlphaFold es una herramienta ya bastante habitual en muchos laboratorios de biología estructural. La tecnología mRNA la conoce el gran público desde las vacunas de la COVID19.

Lo que sí es nuevo —y esto sí importa mucho— es que un solo individuo, sin formación especializada, orquestó un workflow completo que hace cinco años habría requerido un equipo multidisciplinar de biólogos, químicos, bioinformáticos y oncólogos trabajando durante meses. La IA comprimió ese proceso quizá cien veces. No inventó nada. Hizo que el conocimiento existente fuera accesible y ejecutable por alguien de fuera del campo.

Hay otro factor que hace posible esta historia y que nadie debería pasar por alto: Rosie es un perro. Los perros viven fuera del marco regulatorio que protege a los humanos. Esto no es un bug de en esta historia, es precisamente la feature que la hizo posible.

Freeman Dyson predijo algo parecido en 2007, cuando escribió sobre la “domesticación de la biotecnología”. Imaginó un futuro en el que la ingeniería biológica saldría de los laboratorios institucionales y llegaría a garajes y escritorios domésticos, igual que la informática salió de los mainframes corporativos y acabó en los PCs.

La tensión que Dyson anticipó es exactamente la que estamos viviendo: las capacidades se democratizan, pero la regulación sigue siendo profundamente centralizada y conservadora.

Matar un tumor no es lo mismo que curar un cáncer

Patrick Heizer, investigador en terapia celular y génica, ofrece una visión más escéptica y señala algo que la narrativa viral omite: reducir tumores en modelos animales es relativamente frecuente en investigación. Hacerlo de forma segura y a escala es algo mucho más complicado.

Más aún: puedes tener un experimento en animales con el 100% de supervivencia en el grupo tratado y 100% de muertes en el grupo de control (el no tratado), y aún así estar “muy lejos de probar que funciona”.

La razón es biológica y fundamental. Las proteínas cancerosas se parecen mucho a las proteínas sanas. Un tratamiento diseñado para atacar la proteína X del tumor puede acabar atacando la proteína XX en el corazón o en los riñones. Los efectos secundarios graves no aparecen en semanas ni en meses, sino en años. Y los ratones y los perros simplemente no viven lo suficiente para medir supervivencia a cinco años, que es el estándar mínimo en oncología humana.

Heizer describe la posición de los reguladores con una analogía potente: son como los reguladores nucleares después de Chernóbil. Saben que cada capa de burocracia que añaden puede costar vidas por retrasos, pero también saben que cada capa que eliminan puede costar vidas por toxicidad no detectada. Y una vez que se pierde confianza en la tecnología todo se vuelve extremadamente cuesta arriba. No hay respuesta fácil.

Pero Heizer también dice algo no menos cierto y que tiene que dar que pensar: “La FDA dejará morir gente en lista de espera antes de admitir que alguien con ChatGPT y tres mil dólares hizo lo que a ellos les cuesta quince años y dos mil millones.” Hay un exceso de hype con esta historia pero sirve para resalta que existe un conflicto de intereses brutal entre proteger al paciente y proteger al sistema. Y ese conflicto se va a intensificar a medida que la IA haga más obvio lo lento que es el proceso actual.

Founder mode contra el cáncer (si te lo puedes permitir)

Ruxandra Teslo ha escrito sobre un escenario que podría darse: la emergencia de una nueva aristocracia sanitaria.

Compara dos casos:

Sid Sijbrandij, cofundador de GitLab, fue diagnosticado con un osteosarcoma, un cáncer de huesos con pronóstico terrible. Tenía muchos recursos, contactos y mentalidad de emprendedor. Financió tratamientos experimentales, buscó activamente ensayos clínicos, movió cielo y tierra. Resultado: está libre de recidivas desde 2025.

Jake Seliger, escritor, fue diagnosticado con un carcinoma de células escamosas agresivo en cabeza y cuello. No tenía los recursos ni la capacidad de Sijbrandij. Murió en agosto de 2024.

La diferencia entre ambos no fue solo médica. Fue económica y de acceso. Seliger escribió extensamente sobre la crueldad de un sistema que tenía tratamientos experimentales prometedores pero los hacía inaccesibles por diseño regulatorio.

Teslo señala un dato concreto: los ensayos clínicos en Australia son entre dos veces y media y tres veces más baratos y más rápidos que en Estados Unidos, sin que se hayan observado más eventos adversos. No es que sea imposible hacer las cosas más rápido y más barato — es que el sistema regulatorio americano, y por extensión el europeo, no está diseñado para eso.

El problema de fondo es claro: la IA está acelerando brutalmente el diseño de terapias, pero no está acelerando ni su validación ni su acceso. Si no reformamos el sistema regulatorio, lo que vamos a crear es un mundo en el que la gente con dinero y conexiones accede a tratamientos experimentales diseñados por IA, y el resto espera quince años a que pasen por el proceso convencional. Una nueva aristocracia sanitaria que haría palidecer a la que ya existe.

Rachel Thomas, cofundadora de fast.ai, añade: puedes tener los mejores modelos del mundo y aún así empeorar los resultados clínicos si los incentivos del sistema están rotos. Si las farmacéuticas siguen optimizando para maximizar ingresos en lugar de maximizar salud, la IA simplemente les dará herramientas más potentes para hacer lo mismo que ya hacen. Sin gobernanza y rediseño institucional, la IA acelera el descubrimiento científico y al mismo tiempo amplía la desigualdad clínica. Más terapias disponibles, pero no más terapias accesibles.

El lado oscuro que nadie quiere mencionar: si un individuo puede diseñar terapias… también puede diseñar lo contrario.

Hay una conversación que la comunidad tecnológica prefiere evitar: si la IA permite a un ingeniero de software diseñar una vacuna contra el cáncer para su perro, también permite diseñar lo contrario. AlphaFold no distingue intenciones. Modela proteínas con la misma eficacia si quieres atacar un tumor o si quieres atacar un tejido sano.

Históricamente, la bioseguridad era un problema de acceso a laboratorios. Necesitabas equipamiento especializado, reactivos controlados, formación técnica. Las barreras eran físicas. Lo que está cambiando es que la parte más peligrosa del proceso —el diseño— se está convirtiendo en un problema de información y computación, precisamente las dos cosas que se están abaratando más rápido. En 2023, un equipo del MIT demostró que estudiantes sin formación en biología podían usar LLMs para generar planes operativos plausibles para producir patógenos conocidos. No llegaron a fabricar nada, pero el ejercicio demostró que la barrera intelectual ya no es barrera.

Aunque, de nuevo, conviene matizar y no caer en un excesivo alarmismo o doomerismo: un estudio posterior de RAND, también de 2024, concluyó que los LLMs no aumentaban de forma estadísticamente significativa el riesgo operativo de un ataque biológico, ya que la información que proporcionaban era similar a la disponible mediante búsquedas convencionales en internet. Pero los propios autores del estudio de RAND advierten que esto podría cambiar rápidamente con modelos más capaces.

No estoy diciendo que cualquiera pueda fabricar un arma biológica mañana. La síntesis física sigue siendo difícil y las empresas de síntesis de ADN tienen filtros de seguridad. Pero la asimetría es preocupante: defender requiere vigilar todas las posibilidades; atacar solo requiere encontrar una. Y cada mes que pasa, encontrar esa una es un poco más fácil.

La misma democratización que hace posible la historia de Rosie tiene una sombra que no podemos ignorar. No se trata de frenar la tecnología —sería inútil y contraproducente. Se trata de que la bioseguridad necesita el mismo tipo de inversión y urgencia que estamos poniendo en las capacidades. Y ahora mismo no la tiene ni de lejos.

La IA ya no solo busca: descubre

Mientras el caso de Rosie dominaba Twitter, Nature Medicine publicó un

artículo de David Adam titulado “The AI co-scientist is here” que merece mucha más atención de la que recibió.

Adam repasa varios hitos recientes. Uno de los más relevantes es la historia de Rentosertib, un fármaco para fibrosis pulmonar idiopática desarrollado por Insilico Medicine. Lo extraordinario no es el fármaco en sí, sino cómo se descubrió: tanto la diana terapéutica (la quinasa TNIK) como el compuesto fueron identificados íntegramente por IA generativa. Ningún químico humano los había propuesto. La máquina no buscó en una base de datos de moléculas conocidas: generó una molécula nueva para una diana nueva. Los resultados de fase IIa, publicados en Nature Medicine en junio de 2025, fueron prometedores, y la compañía está en conversaciones con reguladores para diseñar ensayos de mayor escala.

Gary Peltz, genetista de Stanford, representa lo que podríamos llamar una nueva generación de uso de la IA: IA generadora de conocimiento. No IA que clasifica, predice, u optimiza; IA que descubre cosas que los humanos no sabían. Peltz puso a prueba el AI co-scientist de Google pidiéndole que propusiera reposicionamiento de fármacos para fibrosis hepática. El sistema sugirió tres candidatos con mecanismos de acción plausibles, respaldados por cientos de papers que ningún humano habría tenido tiempo de cruzar. Dos de los tres funcionaron en el laboratorio.

Pero el ejemplo que más eriza el pelo es el de José Penadés, microbiólogo del Imperial College de Londres. Penadés llevaba años investigando cómo los elementos genéticos móviles —fragmentos parasíticos de ADN— se propagan entre distintas especies de bacterias. Cuando le mostraron los resultados del AI co-scientist sobre su tema de investigación, la IA había propuesto exactamente el mismo mecanismo que su laboratorio había descubierto experimentalmente pero que aún no había publicado. “Estaba realmente en shock”, contó Penadés, que al principio pensó que la IA había accedido a sus datos no publicados. La IA llegó a la misma conclusión que años de trabajo experimental, partiendo solo de la literatura publicada.

Jon Stokes, de la Universidad McMaster, trabaja en descubrimiento de antibióticos con IA y su trabajo pone las cosas en perspectiva: su equipo ha desarrollado herramientas de IA que pueden cribar decenas de miles de compuestos químicos al día, una tarea que por métodos tradicionales llevaría semanas y costaría miles de dólares. El cuello de botella ya no es generar hipótesis ni cribar candidatos, sino priorizarlos y testarlos en el laboratorio.

Los escépticos tienen razón (en parte)

Geoffrey Miller, psicólogo evolutivo, plantea una objeción sobre el impacto que la IA va a tener en y medicina que merece tomarse en serio: no existen datasets biomédicos equivalentes a los enormes corpus de texto e imagen que entrenaron a los LLMs. No hay un “ImageNet de la biología humana”. Y lo que es más importante: no hay forma de hacer “Reinforcement Learning from Physiological Feedback” — no puedes iterar rápidamente sobre datos fisiológicos humanos porque los ensayos clínicos tardan años y cuestan cientos de millones. La IA puede generar hipótesis a velocidad de silicio, pero validarlas sigue requiriendo tiempo biológico.

Miller sugiere provocadoramente que los cientos de miles de millones que se están invirtiendo en inteligencia artificial general, si se destinaran directamente a investigación en longevidad, resolverían el problema más rápido que esperar a que una superinteligencia artificial o haga por nosotros.

La pregunta que importa

Un ingeniero sin formación en biología diseña una vacuna para su perra con ChatGPT y tres mil dólares australiano. Una IA genera un fármaco que ningún químico humano había concebido y llega a fase IIa de ensayos clínicos. Otra IA descubre en horas un mecanismo biológico que a un laboratorio le costó años encontrar. Mientras tanto, en el mundo real, los ensayos clínicos siguen tardando una media de diez años, los costes de desarrollo de un fármaco superan los dos mil millones de dólares, y la diferencia entre vivir y morir depende demasiado a menudo de tu código postal y tu cuenta bancaria.

La IA es un catalizador brutal de posibilidades. Está comprimiendo exponencialmente el tiempo entre “esto podría funcionar” y “hemos diseñado algo que funciona”. Pero el verdadero cuello de botella son las instituciones, los ensayos clínicos, la regulación, el acceso. Todo lo que está entre una molécula prometedora en un ordenador y un tratamiento en el brazo de un paciente.

Jake Seliger murió en agosto de 2024 esperando acceso a tratamientos que existían. Rosie, una perra, los recibió porque nadie tuvo que pedir permiso. Esa frase debería ser insoportable. Y debería ser suficiente para que empecemos a discutir en serio cómo reformar un sistema que fue diseñado para un mundo donde el cuello de botella era el conocimiento, no la burocracia.

Gracias por leer Suma Positiva.

Si te ha gustado esta edición, no te olvides de dar al ❤️ y de compartirla por email o redes sociales con otras personas a las que les pueda gustar.

Suscríbete para no perderte ninguna futura edición.

Un fármaco inhibidor en cáncer es un medicamento diseñado para bloquear (“inhibir”) una proteína o vía concreta que las células tumorales necesitan para crecer, dividirse, repararse o escapar del sistema inmunitario.

En cáncer, “uso compasivo” significa dar a un paciente un medicamento que todavía no está autorizado (o no lo está para esa indicación concreta) cuando la enfermedad es muy grave y no hay alternativas eficaces disponibles.

Los neoantígenos son fragmentos de proteínas generados por mutaciones del ADN de las células tumorales; el sistema inmune los reconoce como algo “extraño”.

Como no aparecen en tejidos normales, son dianas muy específicas para que los linfocitos T ataquen al tumor con menos riesgo de dañar células sanas.

Gracias Samuel por tu aporte, y mi primera reflexión es

¿Nos dejarán rediseñar el sistema sanitario para este nuevo contexto…

o vamos a aceptar una sanidad de dos velocidades? Lamentablemente siempre prima los intereses de unos pocos sobre el resto y como muy bien afirmas todo depende de nuestro CP y nuestros recursos económicos

La burocracia se ha multiplicado desde que la administración copia a la ingeniería y sus procesos.. Documentar, trazabilidad, auditoria.... cuando copias procesos y la maquinaria es más lenta y pesada el resultado es malo.

La burocracia es menos importante que las normas y que las reglas. Alcanzar el punto en el que haya pocas reglas, muy claras y definidas, al tiempo que fáciles de cumplir y muy difíciles de incumplir, es un buen camino.